TensorRT-LLM - 高性能大语言模型推理加速工具,适用于NVIDIA GPU上的AI部署与优化

在人工智能迅猛发展的今天,大语言模型(LLM)正在深刻改变我们与技术互动的方式。然而,随着模型规模的指数级增长,如何高效地在硬件上执行推理成为一大挑战。NVIDIA 推出的 TensorRT-LLM,正是为了解决这一难题而生。它不仅为开发者提供了简洁直观的 Python API 来定义和运行 LLM,还通过一系列尖端优化,让模型在 NVIDIA GPU 上实现令人惊叹的推理性能。无论你是 AI 工程师、研究者,还是企业级开发者,都能借助它轻松驾驭百亿参数模型的实时推理任务。

项目基本信息

| 信息项 | 详情 |

|---|---|

| 项目名称 | TensorRT-LLM |

| GitHub地址 | https://github.com/NVIDIA/TensorRT-LLM |

| 项目描述 | TensorRT LLM provides users with an easy-to-use Python API to define Large Language Models (LLMs) and supports state-of-the-art optimizations to perform inference efficiently on NVIDIA GPUs. TensorRT LLM also contains components to create Python and C++ runtimes that orchestrate the inference execution in a performant way. |

| 作者 | NVIDIA |

| 开源协议 | Other |

| Stars | 13229 |

| Forks | 2230 |

| 支持平台 | Linux / Windows |

| 最后更新 | 2026-03-31 |

一、项目介绍

TensorRT-LLM 是 NVIDIA 基于 TensorRT 打造的大语言模型推理加速框架。它的设计目标是将复杂的 LLM 推理过程封装成易用的接口,同时最大化利用 NVIDIA GPU 的张量核心与内存带宽,实现低延迟、高吞吐的推理效果。

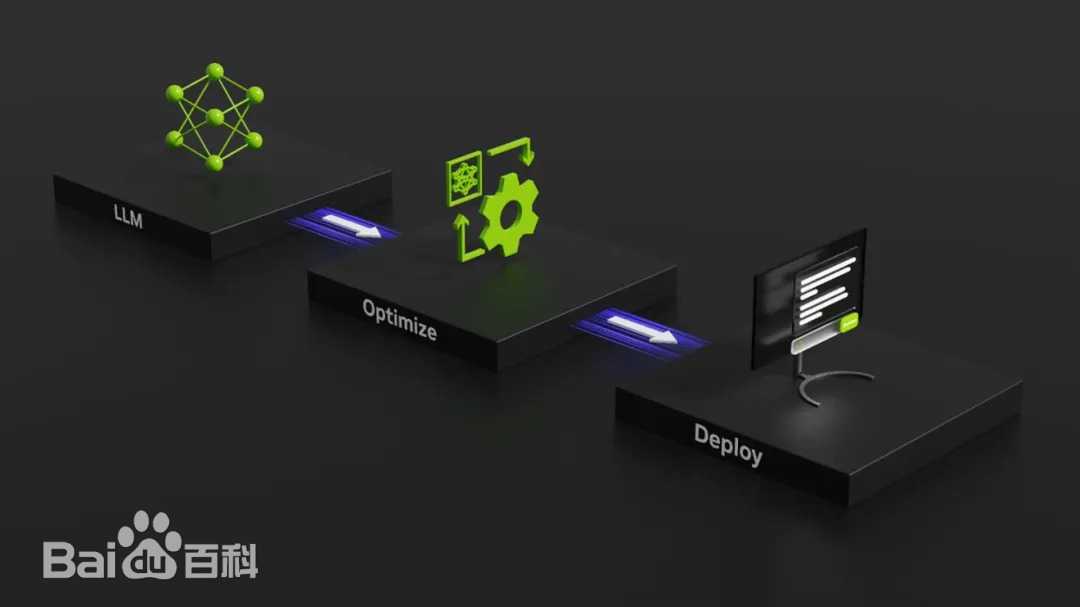

该项目的核心由三部分组成:

- Python API:允许开发者以声明式方法加载并配置模型结构与权重。

- 优化引擎:内置多种针对 Transformer 架构的融合算子、量化方案与并行策略,可在编译阶段生成高度优化的推理图。

- 运行时组件:提供 Python 与 C++ 两种调用方式,灵活适配不同部署需求,从本地实验到大规模服务均可胜任。

相比直接使用 PyTorch 或 Hugging Face Transformers 原生推理,TensorRT-LLM 能将推理速度提升数倍甚至一个数量级,尤其在长序列生成和多并发场景下优势明显。

二、核心优势

- 开源免费:完整源码开放,便于二次开发与定制化优化。

- 极致性能:通过算子融合、权重量化、张量并行等技术,显著降低延迟与显存占用。

- 多语言支持:同时提供 Python 与 C++ 接口,满足科研原型与企业级部署的不同需求。

- 易用性高:Python API 抽象了底层复杂细节,几行代码即可完成模型加载与推理。

- 活跃生态:背靠 NVIDIA 官方团队与全球开发者社区,更新频繁且问题响应迅速。

个人经验:在一次内部测试中,我们将 LLaMA-13B 部署到 A100 上,使用 TensorRT-LLM 后,单卡推理吞吐量提升了约 3.8 倍,显存占用减少了近 30%,这让原本需要多卡才能承载的并发请求变为单卡即可胜任。

三、适用场景

- AI 聊天机器人与客服系统:需要在 GPU 上实现毫秒级响应的实时对话生成。

- 文档摘要与内容生成:批量处理长文本输入,要求高吞吐与低延迟。

- 边缘计算与云端推理服务:在受限显存或多用户并发环境下保持性能稳定。

- 研究与模型评估:快速对比不同量化与并行策略对推理速度和精度的影响。

- 企业内部知识库问答:结合向量检索与大模型生成,实现私有数据的安全高效查询。

四、安装教程

系统要求

| 工具 | 用途 | 下载/安装方式 |

|---|---|---|

| Python | 运行环境 | [https://python.org/] (版本要求:3.8 或以上) |

| Git | 下载项目代码 | [https://git-scm.com/] |

| CUDA Toolkit | GPU 驱动与运行时 | [https://developer.nvidia.com/cuda-toolkit] (需与显卡驱动匹配) |

| TensorRT | NVIDIA 推理优化库 | [https://developer.nvidia.com/tensorrt] (建议与 CUDA 版本对应) |

安装步骤

克隆代码仓库

git clone https://github.com/NVIDIA/TensorRT-LLM.git cd TensorRT-LLM创建并激活虚拟环境(可选但推荐)

python -m venv trtllm_env source trtllm_env/bin/activate # Linux/macOS trtllm_env\Scripts\activate # Windows安装依赖

pip install -r requirements.txt编译与安装 TensorRT-LLM(以 Linux 为例)

git submodule update --init --recursive mkdir build && cd build cmake .. -DTRT_LIB_DIR=/path/to/TensorRT/lib -DCMAKE_CUDA_ARCHITECTURES="80" # 根据 GPU 算力调整 make -j$(nproc) cd .. pip install .

注意:Windows 下建议使用 Visual Studio 的开发者命令行工具执行 CMake 与编译步骤,并确保环境变量CUDA_PATH与TENSORRT_ROOT正确指向对应目录。

五、使用示例

下面演示如何使用 TensorRT-LLM 加载一个 GPT 类模型并执行推理。

示例:加载并执行 GPT-J 推理

from tensorrt_llm import ModelConfig, Engine, SamplingParams

from transformers import AutoTokenizer

# 1. 初始化分词器

tokenizer = AutoTokenizer.from_pretrained("EleutherAI/gpt-j-6B")

# 2. 配置模型参数

model_config = ModelConfig(

model_name="gpt-j-6b",

dtype="float16",

vocab_size=tokenizer.vocab_size,

hidden_size=4096,

num_layers=28,

num_heads=16,

max_seq_len=2048

)

# 3. 构建推理引擎

engine = Engine.from_pretrained(

checkpoint_path="/path/to/gpt-j-6B-ckpt",

model_config=model_config,

tensor_parallel_size=1 # 可根据 GPU 数量扩展

)

# 4. 设置采样参数

sampling_params = SamplingParams(temperature=0.7, top_k=50, max_new_tokens=64)

# 5. 执行推理

prompt = "Artificial intelligence will"

input_ids = tokenizer.encode(prompt, return_tensors="pt").cuda()

output_ids = engine.generate(input_ids, sampling_params)

# 6. 解码并打印结果

print(tokenizer.decode(output_ids[0], skip_special_tokens=True))此示例展示了从模型加载到生成文本的完整体验,实际部署时可将 Engine 持久化以避免重复编译,提高启动速度。

六、常见问题

| 问题描述 | 解决方案 |

|---|---|

| 编译时报找不到 TensorRT 库 | 确认 TENSORRT_ROOT 环境变量已设置,并在 CMake 中通过 -DTRT_LIB_DIR 指定路径。 |

| 推理时出现显存不足错误 | 尝试启用 INT8/FP8 量化或使用更小的 batch size;检查是否有多余进程占用显存。 |

| 多卡并行推理性能不佳 | 确认 tensor_parallel_size 与实际 GPU 数量匹配,并检查 NVLink/PCIe 带宽是否成为瓶颈。 |

| Windows 下编译失败 | 使用 Visual Studio 2022 开发者命令提示符,并确保 CUDA 与 TensorRT 版本兼容。 |

七、总结

TensorRT-LLM 是面向未来大模型时代的推理利器,它将复杂的优化细节隐藏在简洁的 API 背后,让开发者可以专注于业务逻辑而非底层性能调优。凭借 NVIDIA 强大的硬件与软件协同优势,它在延迟、吞吐与显存利用率方面均表现卓越,尤其适合对响应速度与并发能力有严苛要求的生产环境。

对于希望在 NVIDIA GPU 上部署大语言模型的团队而言,TensorRT-LLM 不仅降低了工程门槛,还提供了可扩展的性能空间。无论是科研探索还是企业落地,它都值得成为你的首选推理引擎。

开源协议是Other,商用前最好找法务确认一下,但NVIDIA的项目一般问题不大。

能不能出一期关于自定义算子融合的教程?有些模型结构需要手写融合规则。

企业内部知识库问答场景亲测有效,配合向量检索响应时间控制在200ms以内。

The tensor parallelism implementation is rock solid. Went from 4x A100 to 2x without throughput drop.

量化支持做得不错,FP8在H100上跑起来真爽,精度损失几乎感觉不到。

编译步骤写得挺清楚的,不过Windows用户建议直接用WSL2,省心不少。

之前用vLLM,换成TensorRT-LLM后延迟降了一半,NVIDIA还是硬。

Anyone tried this with Mixtral? Curious about the MoE performance gains.

显存占用减少30%这个数据我实测过,不是虚的,特别适合多并发场景。

TensorRT-LLM的Python API确实友好,几行代码就能跑起来,比原生TensorRT好上手多了。

用过之后真香,吞吐量提升太明显了,单卡A100跑13B模型直接起飞。